LLM提示词的简单技巧:STAR

STAR法则

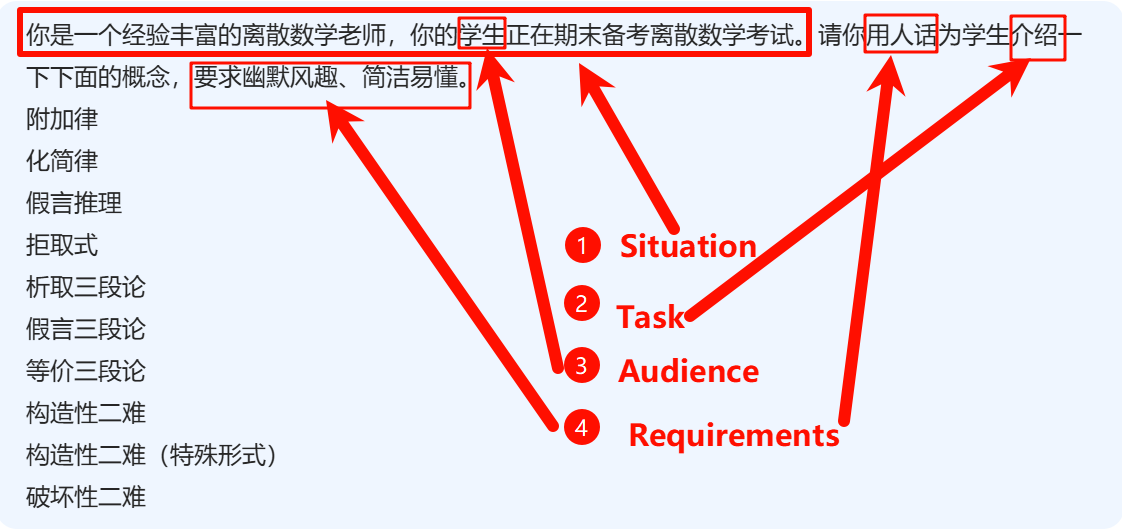

- S: Situation,背景信息

- T: Task,任务目标

- A: Audience,受众

- R: Requirements,输出要求

在提问的时候,给LLM(大语言模型)提供上面四个不同维度的信息,可以让LLM生成更优质的回复。

举一个例子:

提问:

1 | 介绍一下下面的概念: |

回答:

这些概念主要来自逻辑学,尤其是命题逻辑和推理规则。以下是它们的简要介绍:

- 附加律 (Addition)

附加律 是命题逻辑中的一条推理规则,形式为:

- 如果 ( P ) 为真,那么 ( P \lor Q ) 也为真,无论 ( Q ) 是什么命题。

- 即:从 ( P ) 可以推出 ( P \lor Q )。

- 化简律 (Simplification)

化简律 是命题逻辑中的一条推理规则,形式为:

- 如果 ( P \land Q ) 为真,那么 ( P ) 为真,且 ( Q ) 为真。

- 即:从 ( P \land Q ) 可以推出 ( P ) 或 ( Q )。

- 假言推理 (Modus Ponens)

假言推理 是命题逻辑中的一条基本推理规则,形式为:

- 如果 ( P \rightarrow Q ) 为真,且 ( P ) 为真,那么 ( Q ) 为真。

- 即:从 ( P \rightarrow Q ) 和 ( P ) 可以推出 ( Q )。

……这些推理规则在逻辑推理和数学证明中非常有用,帮助我们从已知的命题中推导出新的命题。

使用STAR优化的提问:

回答:

好的,同学们,期末备考紧张吧?别担心,我来给你们“翻译”一下这些离散数学的概念,保证你们笑出声的同时还能记住!

附加律:

这就像你已经有了一包薯片,但你觉得不够,又买了一包。逻辑上就是:如果你知道A是真的,那A∨B(A或B)也肯定是真的。反正A已经在了,B来不来都无所谓,薯片已经到手了!化简律:

这就像你买了一堆东西,结果发现只用了其中一样。逻辑上就是:如果A∧B(A和B)是真的,那A肯定是真的。别管B了,A已经够用了!假言推理:

这就像“如果今天下雨,我就带伞”。结果今天真的下雨了,那你肯定带伞了。逻辑上就是:如果A→B(A推出B),且A是真的,那B也是真的。别淋雨了,带伞吧!……

怎么样?是不是感觉这些概念没那么可怕了?记住,逻辑就像生活,有时候选择多了反而简单!加油备考,你们一定能行的!

使用Deepseek官网的默认模型对话进行测试,效果差异非常明显。

提示词优化输出的本质

相信你应该有听说过提示词能够优化输出。比如说:

假如你是一个经验丰富的Python程序员。现在请你xxx……

这样的“套路化”的提示词,似乎是能够提升一些回复质量的。

现在主流厂家的LLM也在不断的进步。不少产品已经能够自动对用户的需求进行预测和优化了,由提示词带来的提示的边际效应已经初步显现。那么,在这样的情况下,写好的提示词的意义是什么呢?

我认为从本质上来说,优秀的提示词能够给LLM提供更多的信息,这些信息能帮助LLM生成更符合用户预期的内容。

很多用户会觉得LLM“不懂我”,但是其实有可能是用户并没有提供给LLM足够多的背景信息。LLM又不是他们肚子里的蛔虫,怎么会知道用户的具体需求呢?😄

这样不麻烦吗?

你可能会问,每次提问都这么写提示词,不觉得很麻烦吗?

这个问题的答案取决于你的需求。如果是比较简单的问题,比如说你只想让LLM作简单的翻译,让你能够看懂就行了,那确实并没有太大的必要。

但如果是相对重要一些的需求,比如说帮你润色文稿之类的任务,那我还是推荐这么写一下。毕竟一次让LLM获得让你更满意的回复,总比多次去调教好。